Implante cerebral 2.jpg

Los dispositivos, incrustados en 1,5 milímetros de la corteza cerebral, registran las señales eléctricas producidas por las partes del cerebro dedicadas al lenguaje, mensajes que son llevadas fuera del cerebro.

¿Cómo funciona el algoritmo?

De este modo, el algoritmo asocia las señales a fonemas y así compone palabras, con la ayuda de un modelo de lenguaje y un dispositivo por el cual Bennet habla a través de una pantalla a un ritmo de más de 60 palabras por minuto, según consignó la agencia de noticias AFP.

"Ahora podemos imaginar que en un futuro será posible restablecer una conversación fluida en una persona que sufra una parálisis" de lenguaje, aseguró en una rueda de prensa Frank Willett, profesor en Stanford y coautor del estudio.

Esto representa una capacidad para hablar inferior a las 150 o 200 palabras por minuto de una persona normal, pero se trata de un ritmo tres veces superior al logrado por una persona con parálisis de lenguaje en 2021, en otra experiencia científica impulsada por el mismo laboratorio.

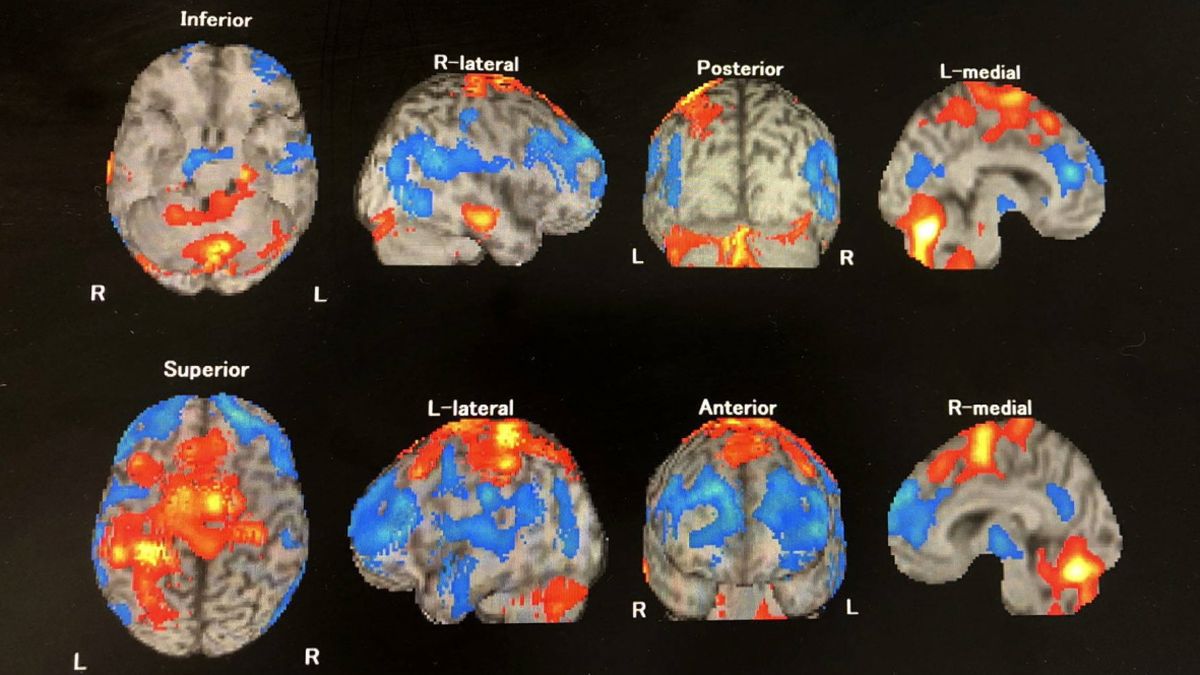

El segundo caso del artículo de Nature fue llevado a cabo por el equipo de Edward Chang en la universidad de California y consta de un dispositivo basado en una banda de electrodos instalados en la corteza cerebral.

Su eficacia resulta comparable a la del estudio de Stanford, con una media de 78 palabras por minuto, y representó un avance enorme para la paciente en que instalaron los electrodos.

Tras haber sufrido una paraplejia debido a una hemorragia cerebral, hasta ahora su capacidad de habla era de 14 palabras por minuto, con la ayuda de una técnica que seguía los movimientos de la cabeza.

Estudio alertó que los contagiados por coronavirus podrían sufrir "daños irreversibles" en el cerebro

Científicos anunciaron avances relevantes en dos proyectos basados en la introducción de implantes cerebrales para devolverle el habla a personas que la perdieron.

Una de las especificidades del dispositivo del laboratorio californiano es que no solo analiza las señales eléctricas de la parte del cerebro dedicada al lenguaje, sino también los movimientos de los labios, la lengua y los otros músculos faciales que producen los sonidos.

"Hace entre cinco y seis años que empezamos a entender las redes eléctricas que rigen los movimientos de los labios, la mandíbula y la lengua y que nos permiten producir los sonidos específicos de cada consonante, vocal y palabra", explicó el profesor Chang.

La interfaz entre el cerebro y el dispositivo de este laboratorio no solo produce lenguaje en forma de texto en una pantalla, sino también con una voz artificial y un avatar que reproduce las expresiones faciales del paciente cuando se expresa.

En consecuencia, el laboratorio de esta universidad de California aspira ahora a desarrollar una versión sin hilos del mismo mecanismo. Esto tendría "consecuencias profundas para la independencia y las interacciones sociales" del paciente, destacó David Moses, coautor del estudio y profesor de neurocirugía en la universidad de San Francisco.